AIの分野でいう「Embedding(エンベディング、埋め込み)技術」とは、テキストや画像、音声など複雑な情報を、意味を保ったままコンピューターが扱いやすい数値ベクトルに変換する手法を指します。埋め込み表現とも呼ばれるこの方法により、従来は数値化が難しかったデータの意味や特徴を数理的に捉え、AIが理解できる形に落とし込むことが可能になります。この技術は、言語理解や画像認識、レコメンドなど様々なAIアプリケーションの基盤となっており、効率的なデータ処理と高度な分析を支えています。この記事では、埋め込み技術の基本概念や仕組みから、主要な手法、実用的なユースケース、直面する課題、そして将来の展望について詳しく解説します。

埋め込み(Embedding)技術とは何か?基礎を理解しましょう

埋め込み(Embedding)技術の定義

埋め込み(Embedding)技術とは、テキストや画像などのデータを数値の集合(ベクトル)で表現する方法です。ベクトル空間にデータをマッピングすることで、似たもの同士は近くに配置され、データの特徴や関係性を定量的に捉えられます。また、非数値の情報を数値化することで、コンピューターはその意味や類似性を計算で扱えるようになります。典型的にベクトルは数十〜数百次元で構成され、データの多面的な特徴を表現できます。

埋め込み表現の仕組み

埋め込みは通常、機械学習モデル(ニューラルネットワークなど)によって自動生成されます。モデルは大量のデータからパターンを学習し、似た入力同士を近いベクトルに写像するよう訓練されます。例えば、自然言語処理では単語が類似した文脈で出現するほど、対応する単語ベクトルも互いに近くなるようモデルが調整します。同様に、画像では深層学習モデルが視覚的特徴を捉え、似た画像ほど近いベクトルで表現します。

数値ベクトル化、データを数値化する重要さ、意義

データを埋め込み表現として数値化することには意義があります。数値ベクトル化されたデータは、機械学習アルゴリズムの入力として直接扱うことができ、ベクトル間の距離など数学的手法で類似度を定量的に評価できます。また、高次元の情報を適切に圧縮することでデータの本質的なパターンを抽出でき、計算効率も向上します。さらに、テキストと画像のように異なる種類のデータ同士でも、埋め込み空間上で比較や統合が可能になることが利点です。

従来の表現手法との違い

従来、テキストではワンホットエンコーディングなど、高次元かつ各データが独立した表現が主流でした。例えば単語は語彙数の次元を持つベクトルでその単語に対応する位置だけ1とするため、単語間の意味的な近さを表現できません。これに対して埋め込み表現では、低次元の連続値ベクトルで意味情報を保持し、似たデータ同士はベクトルも近くなるという違いがあります。また、埋め込みは機械学習で自動獲得されるため、人手による特徴抽出より柔軟です。

埋め込み技術の基本例

埋め込み技術の基本例として、単語のベクトル表現を考えてみます。埋め込み空間(ベクトル空間)では「犬」と「猫」のベクトル間の距離は「犬」と「車」の距離よりも短く、動物同士の単語は互いに近い位置に配置されます。つまり、埋め込みによって意味が近いデータほど数値表現も似通ったものになることがわかります。このような埋め込みの性質はテキスト以外のデータでも同様で、画像や音声においても、内容が似ていれば埋め込みベクトルが近くなります。

埋め込み技術の主要手法

単語Embedding(単語埋め込み)

単語Embeddingは自然言語処理の基礎的技術で、個々の単語を数値ベクトルに変換します。意味が似た単語ほどベクトルも近くなるように学習されており、これによりコンピューターは単語間の意味関係を数値的に扱いやすくなります。Word2VecやGloVeなどの手法が代表例です。近年では、BERTのように文脈に応じて単語のベクトルが動的に変化する高度な埋め込みモデルも登場しています。

文章Embedding(文章埋め込み)

文章Embeddingは、文や段落といったより長いテキスト全体を一つのベクトルに変換する手法です。単語Embeddingの発展形で、文中の語順や文脈を考慮してテキスト全体の意味をベクトルに集約します。これにより文章同士の類似度比較や文書分類などが可能になり、検索エンジンや質問応答システムで活用されています。代表的な手法として、Doc2VecやSentence-BERTなどが挙げられます。

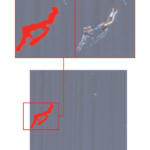

画像Embedding(画像埋め込み)

画像Embeddingは、画像の持つ視覚的な特徴を数値ベクトルで表現する技術です。ディープラーニングの画像認識モデル(CNNなど)の中間層や出力層から得られる特徴ベクトルが埋め込みとして利用されます。これにより、画像同士の類似度比較や画像検索、分類タスクにおいて、画像を数値的に扱うことが可能になります。例えば、学習済みのResNetなどのモデルから抽出したベクトルは画像の埋め込みとして広く用いられています。

音声Embedding(音声埋め込み)

音声Embeddingは、音声データを特徴ベクトルに変換する手法です。音声波形から周波数成分や特徴を抽出し、それらを数値ベクトルとして表現します。従来はメル周波数ケプストラム係数(MFCC)などの手法が用いられましたが、現在ではニューラルネットワークを用いて声紋や話者特徴を直接埋め込みベクトルとして獲得する方法が発展しています。音声Embeddingは音声認識や話者識別、感情解析などに活用されています。

グラフEmbedding(グラフ埋め込み)

グラフEmbeddingは、ネットワーク構造を持つデータ(グラフ)の要素をベクトル表現に変換する技術です。ソーシャルネットワークにおけるユーザー間の繋がりなど、グラフ上の構造情報を各ノードの埋め込みベクトルに反映します。これにより、グラフ上で近いノードほどベクトル空間でも近くなり、クラスタリングやリンク予測などに応用できます。代表的な手法にnode2vecやGraphSAGEなどがあります。

埋め込み(Embedding)の実用ユースケース

検索エンジンでの埋め込み活用

検索エンジンでは、埋め込みによって実現されるベクトル検索が注目されています。クエリ(検索問い合わせ)と文書をそれぞれベクトルに変換し、従来のキーワード一致では拾えない意味的な関連性をもとに検索結果を取得できます。これにより、ユーザーは表現が異なっていても内容が類似した情報を見つけることが可能になります。Googleやベクトルデータベース技術の普及により、実用的な意味検索が実現しています。

レコメンドシステムでの埋め込み活用

レコメンドシステムでは、ユーザーやアイテム(商品、コンテンツなど)をベクトルで表現し、互いの類似度に基づいて推薦を行います。例えば、ユーザーの閲覧履歴や評価から嗜好を埋め込みベクトルとしてモデル化し、そのベクトルに近いアイテムを提示することで、よりパーソナライズされたおすすめが可能になります。埋め込みは協調フィルタリングやコンテンツベースフィルタリングの高度化に寄与しており、多くのオンラインサービスで活用されています。

自然言語処理(NLP)への応用

自然言語処理(NLP)の幅広いタスクにおいて、埋め込みは不可欠な役割を果たしています。テキスト分類や感情分析、機械翻訳といったタスクでは、単語や文章をベクトル化した特徴量をモデルに入力することで、精度向上が図られています。また、大規模言語モデル(LLM)においても、単語や文が内部で埋め込み表現に変換され、文脈を考慮した高度な言語生成や理解を可能にしています。

対話型AI(チャットボット)への利用

対話型AI(チャットボット)でも埋め込みが活躍しています。ユーザーの発言やシステムの知識をベクトル化することで、やり取りの文脈や意図をより正確に把握できます。特に、ChatGPTのような大規模言語モデルと外部知識データベースを組み合わせたシステムでは、質問に関連する文献や情報を埋め込みベクトルを用いて検索し、適切な回答生成に役立てています。

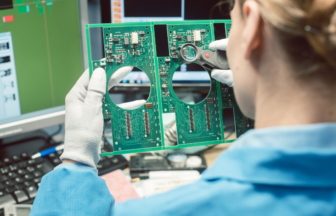

画像処理・解析への埋め込み応用

画像分野でもEmbeddingは様々な応用があります。画像検索では、クエリ画像をベクトル化してデータベース内の画像ベクトルと比較し、類似する画像を探し出すことが可能です。また、顔認証システムでは人物の顔写真を埋め込みベクトルに変換し、事前に登録された顔ベクトルと近さを比較することで個人を識別します。画像のEmbeddingにより、視覚データを効率的に検索・分類・分析できるようになりました。

埋め込み(Embedding)が抱える技術的課題

高い計算コストとリソース消費

高度な埋め込みモデルの学習や運用には膨大な計算資源が必要となり、コストが大きな課題です。大規模なテキストや画像データから埋め込みを学習する際、高性能GPUで長時間の訓練が必要になることも珍しくありません。さらに、大量のベクトルを扱う際にはメモリ消費や検索アルゴリズムの面でも負荷が大きくなります。こうした計算コストとリソース負担は、埋め込み技術を大規模に活用する上での障壁となっています。

埋め込みに内在するバイアス

埋め込みモデルは、学習データ中の偏り(バイアス)を引き継いでしまうリスクがあります。例えば、単語Embeddingでは性別や人種に関するステレオタイプが反映され、「医師」は男性、「看護師」は女性といった偏見がベクトル上に現れることがあります。こうしたバイアスはAIの判断に不公正をもたらす可能性があり、Embeddingの利用にあたって対策が求められます。

ブラックボックス性と解釈性

埋め込みで得られるベクトルは、人間にとって意味づけが難しいブラックボックスになりがちです。各次元が何を表しているのか直感的に理解できず、なぜあるデータ同士が近いベクトルになったのかを説明することも容易ではありません。そのため、モデルの判断根拠を説明したり、異常な挙動を解析したりする際に困難が生じます。特に医療や金融など説明責任が重要な分野では、埋め込みの解釈性の欠如が採用の障壁になることもあります。

埋め込みモデルの更新と維持

埋め込みモデルを一度学習すると、新たなデータやトレンドの変化に柔軟に対応することが難しい場合があります。例えば、言語Embeddingでは新語の出現や単語の意味変化に追随するには再学習が必要になることが多く、既存のベクトル空間にそれらを後から滑らかに追加することは容易ではありません。このように、埋め込みモデルを継続的に最新の状態に保つことは技術的な課題です。

プライバシーとデータ漏えいの懸念

埋め込みベクトルは元データの圧縮表現であり、完全に匿名化されているわけではありません。解析によって元の情報や個人データの一部が推測される恐れがあるため、プライバシー上のリスクが指摘されています。また、埋め込みサービスの利用時に機密データを外部に提供すれば、情報漏えいの可能性も伴います。従って、個人情報や機密データをE埋め込みする場合は、暗号化や厳重なアクセス制限など適切な対策を講じる必要があります。

埋め込み(Embedding)分野の今後、将来

異種データを統合するマルチモーダルEmbedding

テキスト・画像・音声・動画など異なる種類のデータを共通の埋め込み空間で扱うマルチモーダルEmbeddingの研究が進んでいます。例えば、画像と文章を同じ空間にベクトル化すると、文章で画像を検索したり画像から文章を生成したりといった応用が可能になります(OpenAIのCLIPなどで実現)。このように、異種データを統合的に扱えるEmbeddingの進化により、AIの理解・生成能力が今後さらに拡張していくでしょう。

埋め込み表現の効率化と量子化技術

埋め込みの効率化に向けて、ベクトルの次元圧縮や量子化(低ビット化)による軽量化が進められています。高次元ベクトルをそのまま扱うと計算や保存コストが大きいため、成分を8ビット程度に量子化するなどして、精度をほぼ維持しながらモデルのサイズ削減と検索高速化を図ります。今後、こうした省メモリ・高速処理の技術改良が進み、より大規模な埋め込みのリアルタイム利用が可能になるでしょう。

説明可能な埋め込みへの期待

埋め込みの説明可能性を高めることも重要なテーマです。ブラックボックスなベクトルに対し、人間が理解できる意味を持つ次元を設けたり、ベクトルの変化を可視化して入力特徴と結び付けたりする研究が進んでいます。こうした工夫により、AIの判断根拠を示しやすくし、システムの信頼性向上につなげようという狙いがあります。

大規模言語モデル(LLM)との連携

大規模言語モデル(LLM)の台頭により、埋め込みとの相互活用が一段と重要になっています。例えば、LLMを強化する手法として、埋め込みを用いて外部の知識データベースから関連情報を検索し、回答生成に組み込むRAG(Retrieval-Augmented Generation)が注目されています。今後もLLMと埋め込みを組み合わせたソリューションが多く開発され、より高度なAIサービスが実現していくでしょう。

社会実装と標準化の展望

今後、埋め込み技術の社会実装が加速すると予想されます。現在は主に大規模IT企業などで用いられていますが、オープンソースのモデル公開やベクトルデータベースサービスの充実により、中小企業や様々な業界でも取り入れやすくなるでしょう。さらに、業界標準の策定が進めば普及はいっそう促進されるはずです。埋め込みが社会に広く浸透すれば、ユーザーは意識せずとも高度なパーソナライズや検索機能などAIの恩恵を享受できるようになるでしょう。